Meson De Trabajo Mural C/Repisa Infer Eco 430 Top 1.2Mm Other Galv. Wt-600E Ventus

Agrega el producto al carrito para cotizar el envío.

- Descripción

- Ficha Técnica

Descripción

- Cubierta de acero inoxidable 430 de 1,2 mm de espesor.

- Viga de refuerzo de 1 mm. de espesor, en perfil 30×30 mm a lo largo de toda la cubierta.

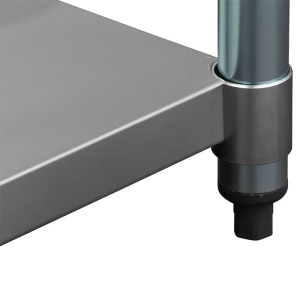

- Subcubierta y patas galvanizadas.

- Patas de perfil tubular de alta resistencia.

- Patines regulables.

Descripción corta

Dimensiones equipo (cm): 60x60x85

Peso Bruto: 13 kg

Peso Neto: 11 kg

Descargar Ficha

Descargar Ficha